كتب : أحمد سليمان

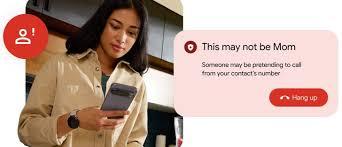

أثبتت مقاطع الفيديو المزيفة ” Deepfake ” أنها مشكلة بعدما رأينا مدى قدرتها على الإقناع، ولكن يبدو أنه بينما تمثل مقاطع الفيديو المزيفة مشكلة، فقد تمثل المحادثات الصوتية المزيفة مشكلة أيضًا يجب علينا الإنتباه إليها في المستقبل، خاصة بعد وجود تقرير يفيد أنه تم خداع موظف في شركة لتحويل أكثر من 200 ألف دولار إلى المخادع، معتقدًا أنه رئيسه في العمل. وفي حالة ما إذا لم تسمع عن Deepfake من قبل، فهو عبارة تقنية من تقنيات الذكاء الاصطناعي، والتي تُستخدم لإنتاج فيديو أو الصوت أو التعديل على محتواه بشكل كامل ليعرض شيئًا لم يكن موجودًا فيه بالأصل.

ووفقا لتقرير من صحيفة وول ستريت جورنال الأمريكية، فقد قام المتصل بخداع الضحية ليعتقد أن المتصل كانه هو الرئيس التنفيذي للشركة الأم لشركته في ألمانيا. كان هذا بسبب استخدام لهجة ألمانية، حيث يبدو أنها تشبه إلى حد كبير لهجة ولحن صوت رئيسه، وهذا هو السبب الذي جعله يعتقد أن رئيسه هو من إتصل به.

ثم طُلب منه تحويل 220 آلف يورو، وهو ما يعادل 243 آلف دولار إلى مورد مجري في غضون ساعة، وهو ما فعله. ومع ذلك، يبدو أن المخادع تمادى كثيرًا لأنه قام بإستدعائه مرة ثالثة بإستخدام رقم مختلف، وبالتالي شكك الضحية في صحة المتصل ولم يستجب لطلبه.

هذه ليست هي المرة الأولى التي يتم فيها إستخدام الذكاء الإصطناعي لإعادة إنشاء أصوات الأشخاص. في الأونة الأخيرة، أثبتت شركة تدعى Desa أن ذلك ممكن عن طريق محاكاة البودكاستر Joe Rogan، حيث كان الصوت المُزيف مشابهًا إلى حد مخيف للشخص الحقيقي .