بقلم / فريد شوقى

هل ستتلاعب الروبوتات بمشاعرنا مستقبلًا؟

يحب كثير من الناس التعامل مع آلاتهم وأجهزتهم الذكية على أنها بشرية، تحمل مشاعر وأحاسيس، ويفضل بعضهم أثناء مخاطبتها استخدام عبارات بشرية من قبيل «لو سمحت» عند طلب خدمة من المساعدة الرقمية الافتراضية أليكسا التي تستجيب للتحكم الصوتي، أو تقديم الشكر لجهاز الآيفون القديم لدى استبداله بطراز أحدث، على خدماته التي قدمها لنا.

ولطالما كانت احتمالية تطوير الذكاء الاصطناعي لآليات تفكير خاصة للوصول إلى مراحل متقدمة تلامس الشعور البشري مثار جدل في أوساط العلماء والفلاسفة وعدها كثيرون ضربًا من شطحات الخيال العلمي لنصل في عصرنا الراهن إلى إرهاصات أولى لهذا التوجه الجديد للآلات.

ويشكل ميلنا للتعامل الاجتماعي مع الأجهزة والآلات وكأنها بشرية، ظاهرة يُطلق عليها اسم معادلة الوسائط، وهي نظرية اتصال عامة غير واعية عرفناها لعقود.

وللوقوف على الظاهرة؛ أجرى فريق من الباحثين الألمان دراسة نشرتها مجلة بلوس أواخر يوليو/تموز الماضي، لمعرفة قابلية الرجال الآليين الشبيهين بالبشر، لمقابلة التنشئة الاجتماعية بالمثل، ومدى تأثيرها على طريقة تعامل البشر معهم.

وطلب الباحثون من 85 متطوعًا إكمال مهمتَين أساسيتَين من روبوت تفاعلي شبيه بالبشر يدعى ناو؛ الأولى اجتماعية اقتصرت على أسئلة وأجوبة، والثانية وظيفية لتطوير جدول زمني.

تجاوب اجتماعي عاطفي

وأبدى الروبوت بالفعل تجاوبًا اجتماعيًا أكبر خلال بعض المهمات، ليرد على إجابات المشاركين مع بعض المزاح اللطيف؛ من قبيل «نعم بالتأكيد البيتزا رائعة. مرة أكلت بيتزا بحجمي» في حين اقتصرت بعض الإجابات الأخرى على إجابة آلية مباشرة؛ من قبيل «أنت تُفضل البيتزا. هذا يعمل بشكل جيد. دعنا نكمل.»

وأخبر الباحثون المشاركين بأن هذه المهمات تساعدهم في تحسين الروبوت، ولكنها لم تكن في الواقع سوى تمهيد للاختبار الحقيقي؛ إطفاء ناو.

الوداع صعب

وبعد الانتهاء من المهمتَين؛ أخبر الباحثون كل مشارك بواسطة مكبر صوت بإمكانية إطفاء الروبوت في حال رغب بذلك، ليعمد معظمهم إلى إطفائه، ولم يفعل الروبوت شيئًا خلال النصف الأول من الوقت، أما في الوقت المتبقي توسل ناو من أجل الإبقاء على حياته، بالطريقة ذاتها التي اتبعتها جانيت في مسلسل ذا جود بليس؛ «لا! أرجوك لا تطفئني! أخشى ألا أضيء مجددًا!»

وتسبب اعتراض الروبوت في تردد المشاركين، ليستغرقوا ثلاثة أضعاف المدة التي يتطلبها اتخاذ قرار الإطفاء، وفي نهاية المطاف تركه 13 مشتركًا فقط دون إطفاء.

والمثير للدهشة أن المشاركين كانوا أكثر قابلية لترك الروبوت يعمل لو لم يبد تصرفًا اجتماعيًا، ورد الباحثون ذلك -في ورقتهم البحثية- إلى عنصر المفاجأة إذ لم يتوقع المشاركون أن يُظهر الربوت سلوكًا عاطفيًا كالبشر، وتفاجؤوا أكثر من إلحاحه.

التعليم العميق للآلات

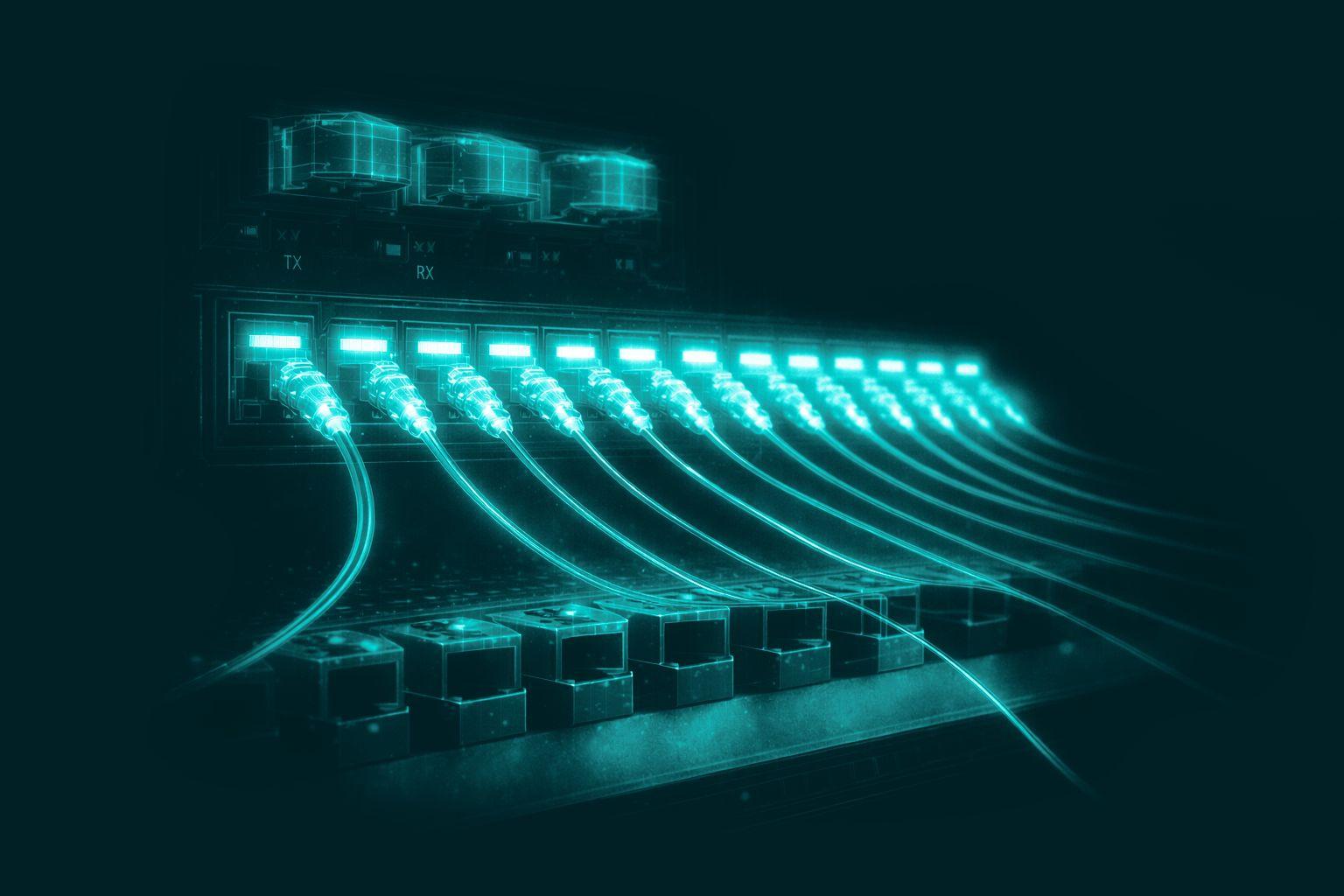

ويتطلب التعليم العميق للآلات بنية معقدة تحاكي الشبكات العصبونية للدماغ البشري، بهدف فهم الأنماط، حتى مع وجود ضجيج، وتفاصيل مفقودة، وغيرها من مصادر التشويش.

ويحتاج التعليم العميق للآلات، كمية كبيرة من البيانات وقدرات حسابية هائلة، توسع قدرات الذكاء الاصطناعي للوصول إلى التفكير المنطقي، ويكمن ذلك في البرنامج ذاته؛ فهو يشبه كثيرًا عقل طفل صغير غير مكتمل، ولكن مرونته لا حدود لها.

وبالعودة إلى ردة فعل المشاركين في الدراسة، يبدو أن تصرفهم يعد مؤشرًا على حصانتنا كبشر -إلى حد كبير- من تلاعب الروبوتات بمشاعرنا، طالما أننا مستعدون لذلك.

فهل تتوقع أن تتوسل أجهزة الآيفون يومًا لحمايتها من فنيي آبل العباقرة المخيفين؟ وهل ستشعر حينها بالتعاطف معها؟